🤖 KI im Recruiting: Wenn Absagen sich wie eine Maschine anfühlen

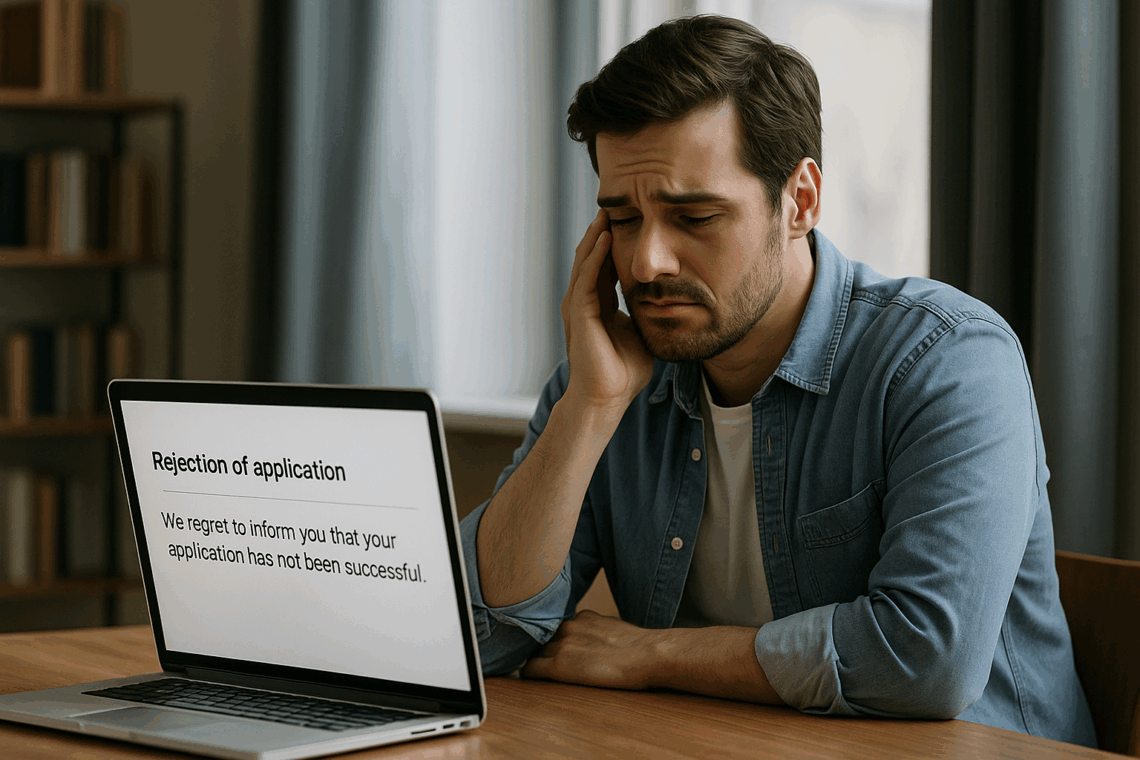

Einstieg: Meine Erfahrung

Ich habe es selbst erlebt: Innerhalb weniger Stunden nach einer Bewerbung kam die Absage – am Sonntagabend.

In der Mail stand, mein Lebenslauf sei „gründlich studiert“ worden. Doch es war offensichtlich: Dieser Text war generisch, unpersönlich und hatte nichts mit meiner Bewerbung zu tun.

Und mein Gefühl?

Kalt. Austauschbar. Wertlos!

Es wirkte, als hätte nicht ein Mensch entschieden, sondern eine Maschine.

Genau hier liegt das Problem: KI kann Recruiting schneller machen – aber wenn sie falsch eingesetzt wird, zerstört sie Vertrauen und Employer Branding.

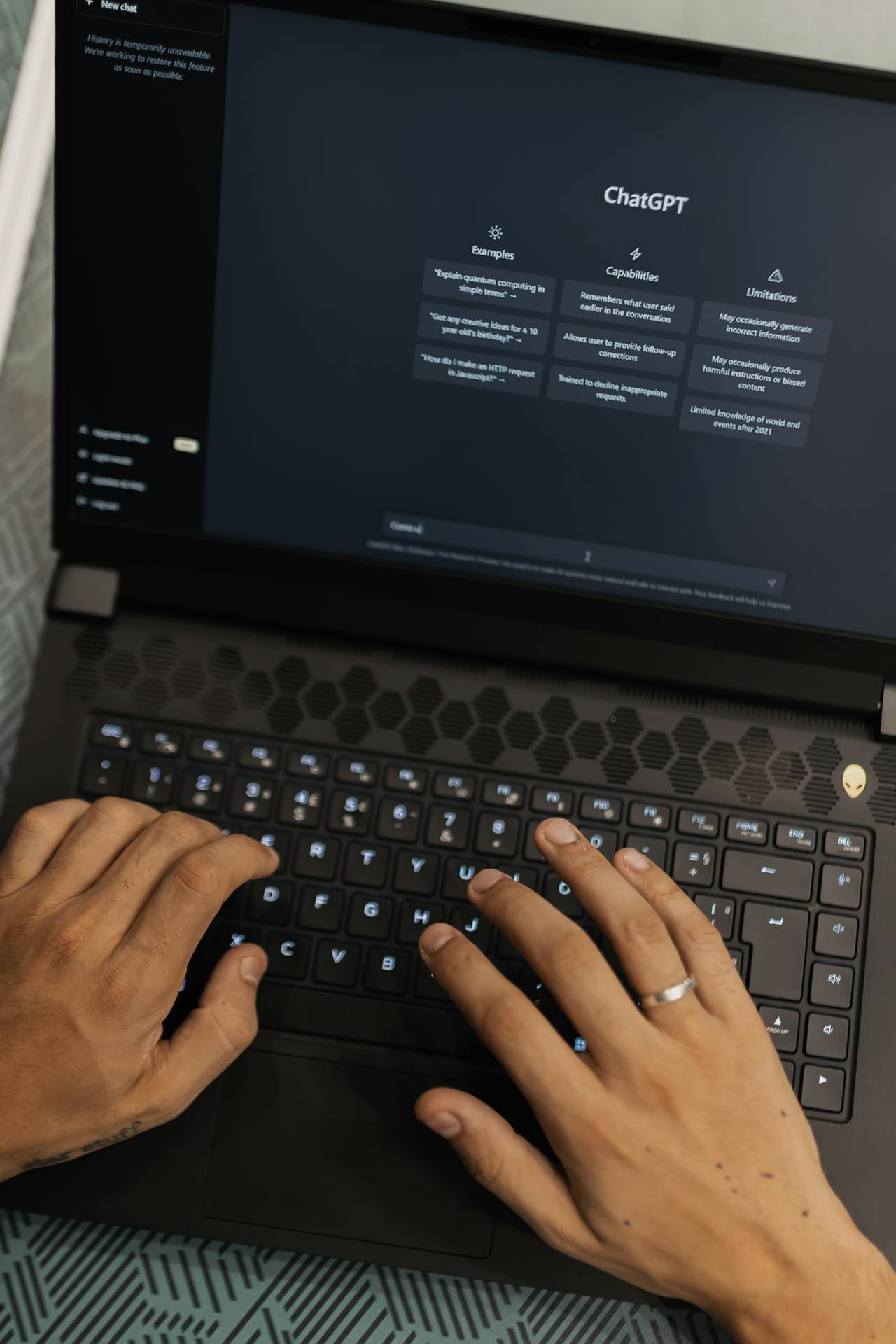

Das Problem: KI als kalter Filter

Immer mehr Unternehmen setzen KI im Recruiting ein – fürs Screening von Lebensläufen, für Video-Interviews, für Chatbots im Bewerbungsprozess.

- Für HR bedeutet das: enorme Zeitersparnis.

- Für Bewerbende bedeutet es oft: Anonymität, Intransparenz und Frust.

Eine aktuelle Studie zeigt: 96 % der US-Unternehmen nutzen bereits KI im Recruiting (Time, 2025). In Deutschland setzt laut Bitkom immerhin schon ein Drittel aller Unternehmen KI im HR-Bereich ein – Tendenz steigend.

Doch: 72 % der Bewerber:innen bewerben sich nach einer schlechten Erfahrung nicht noch einmal (CareerArc Candidate Experience Report, 2024). Damit geht wertvolles Potenzial dauerhaft verloren.

Die drei Chancen – wenn KI richtig eingesetzt wird

1️⃣ Assistenz statt Ersatz

KI darf nicht Recruiter:innen ersetzen, sondern muss sie unterstützen. Statt Bewerber vorschnell auszusortieren, kann sie helfen, Daten zu strukturieren und Bias zu reduzieren.

- 53 % der HR-Leiter:innen sehen KI bereits als Entscheidungs-Hilfe, nicht als Ersatz (HireVue, 2025).

- Das schafft Zeit, um mit den besten Kandidat:innen wirklich ins Gespräch zu gehen.

Mini-Story: Ein HR-Manager muss täglich 300 Bewerbungen sichten. KI filtert vor – er hat endlich Zeit, die besten 20 Menschen kennenzulernen.

2️⃣ Candidate Experience verbessern

Heute erleben Bewerber:innen oft kalte, generische Absagen. Doch KI könnte das Gegenteil leisten:

- automatisiertes, personalisiertes Feedback,

- transparente Kommunikation,

- individuelle Candidate Journeys.

Die Uni Melbourne zeigte 2025: Bei KI-Interviews entstehen gravierende Fehler – bis zu 22 % falsche Transkriptionen bei Nicht-Muttersprachlern. Ohne menschliche Kontrolle leidet die Fairness.

Mini-Story: Eine Bewerberin erhält nach ihrem Interview sofort Feedback – automatisch generiert, aber individuell formuliert. Auch wenn es nicht klappt, fühlt sie sich wertgeschätzt.

3️⃣ Bias reduzieren – wenn Menschen die Regie behalten

KI kann helfen, Diversität zu fördern – z. B. indem Geschlecht, Herkunft oder Alter beim Screening ausgeblendet werden.

Best Cases: Wenn KI Menschlichkeit verstärkt

Der Warden Report (2025) belegt: KI-Systeme treffen bis zu 45 % fairere Entscheidungen für Frauen und Minderheiten als Menschen – vorausgesetzt, die Systeme werden sauber trainiert.

Mini-Story: Ein IT-Team testet ein KI-Modell, das Namen und Geschlecht ausblendet. Plötzlich kommen Talente auf die Shortlist, die vorher durchs Raster gefallen wären.

Negativbeispiele: Wenn KI scheitert

📉 Amazon (2018)

Amazon testete ein KI-Recruiting-System, das automatisch Lebensläufe bewerten sollte. Ergebnis: Das System bevorzugte männliche Kandidaten – weil es mit historischen Daten trainiert war, in denen Männer dominierend vertreten waren.

👉 Fazit: Wenn KI unreflektiert eingesetzt wird, reproduziert sie alte Vorurteile – nur schneller und effizienter.

😨 Stretch Lab (2025)

Noch aktueller ist ein Fall aus den USA: Eine Bewerberin berichtete von einem AI-gesteuerten Interview bei Stretch Lab (Ohio).

Statt sinnvoller Fragen hörte sie 14 Mal in 25 Sekunden nur den Satz: „vertical bar pilates“.

Sie beschrieb das Erlebnis als „creepy“ – wie eine Szene aus Black Mirror. Das Video dazu ging viral.

👉 Fazit: Technische Glitches können nicht nur Prozesse stören – sie zerstören Vertrauen. Wer so etwas erlebt, bewirbt sich garantiert nie wieder bei diesem Unternehmen.

Die unterschätzte Folge: Einmal verbrannt = für immer verloren

Was viele Unternehmen vergessen:

Bewerber:innen merken sich, wie sie behandelt werden.

- Laut CareerArc (2024) bewerben sich 72 % der Kandidat:innen nach einer schlechten Erfahrung nicht erneut.

- Über 55 % teilen ihre Enttäuschung öffentlich – im Freundeskreis, auf Bewertungsportalen oder sogar auf LinkedIn.

👉 Mit jeder unpersönlichen, KI-generierten Absage verbrennen sich Unternehmen Talente – und schädigen langfristig ihr Employer Branding.

Und das kostet: Studien schätzen, dass jede Fehlbesetzung oder nicht zustande gekommene Einstellung zwischen 30.000 und 50.000 € kosten kann.

Best Cases: Wenn KI Menschlichkeit verstärkt

KI im Recruiting ist nicht per se schlecht – es kommt auf den Einsatz an. Beispiele aus der Praxis:

- Chatbots für Bewerberfragen, die rund um die Uhr verfügbar sind.

- Matching-Algorithmen, die Potenziale erkennen statt nur Keywords.

- Automatisierte Feedback-Tools, die Bewerbenden Wertschätzung geben.

KI-Tools „Made in Germany“ – wenn Technik und Vertrauen zusammenpassen

Gute Nachricht: Es gibt auch spannende Lösungen „Made in Germany“, die speziell auf die Anforderungen von HR in KMUs und Mittelstand zugeschnitten sind.

1️⃣ Für KMUs – schnell starten, Kosten sparen

- KI-Recruiter® – automatisierte Vorselektion, bis zu 91 % Kostenreduktion.

- Paul’s Job AI – übernimmt Routineaufgaben, DSGVO-konform.

2️⃣ Für Candidate Experience & Fairness

- everbay KI-Assistenz – verbessert Bewerberkommunikation.

- Retorio (München) – analysiert Persönlichkeit, ethisch spannend & kontrovers.

3️⃣ Für Prozess- & Datenintegration

- P&I AG – große HR-Plattform, Basis für smarte HR-Prozesse.

- aiio GmbH – KI-gestütztes Prozessmanagement.

👉 Fazit: Deutsche Tools punkten durch Datenschutz, Praxisnähe und Fairness – und sind für KMUs eine echte Alternative zu internationalen Anbietern.

Praxis-Checkliste: 5 Fragen vor dem Einsatz von KI im Recruiting

- Weiß der Bewerber, dass KI im Prozess eingesetzt wird?

- Wer trifft die finale Entscheidung – Mensch oder Maschine?

- Gibt es regelmäßige Audits auf Bias und Fairness?

- Wird Candidate Experience verbessert oder verschlechtert?

- Passt das Tool zu Größe & Kultur meines Unternehmens?

Fazit: Mensch + Maschine

Was ich gelernt habe: KI ist nicht das Problem.

Das Problem ist, wenn sie falsch eingesetzt wird – kalt, anonym, ohne Menschlichkeit.

Recruiting bleibt eine zutiefst menschliche Aufgabe.

KI kann Prozesse fairer und effizienter machen. Aber:

👉 Die Entscheidung, ob ein Mensch ins Team passt, darf niemals allein eine Maschine treffen.